本文深度解析会务管理系统后台架构如何通过分布式服务器集群、智能负载均衡、数据库读写分离等技术,支撑在线注册、电子签到等前台功能的百万级并发处理。以快会务服务过的国际医药峰会、全球科技大会等案例为实证,揭示系统弹性扩展、实时监控预警等能力如何确保参会者零感知技术波动。通过技术细节与实战经验的结合,展现智能会务后台如何成为保障会议流畅运行的隐形引擎。

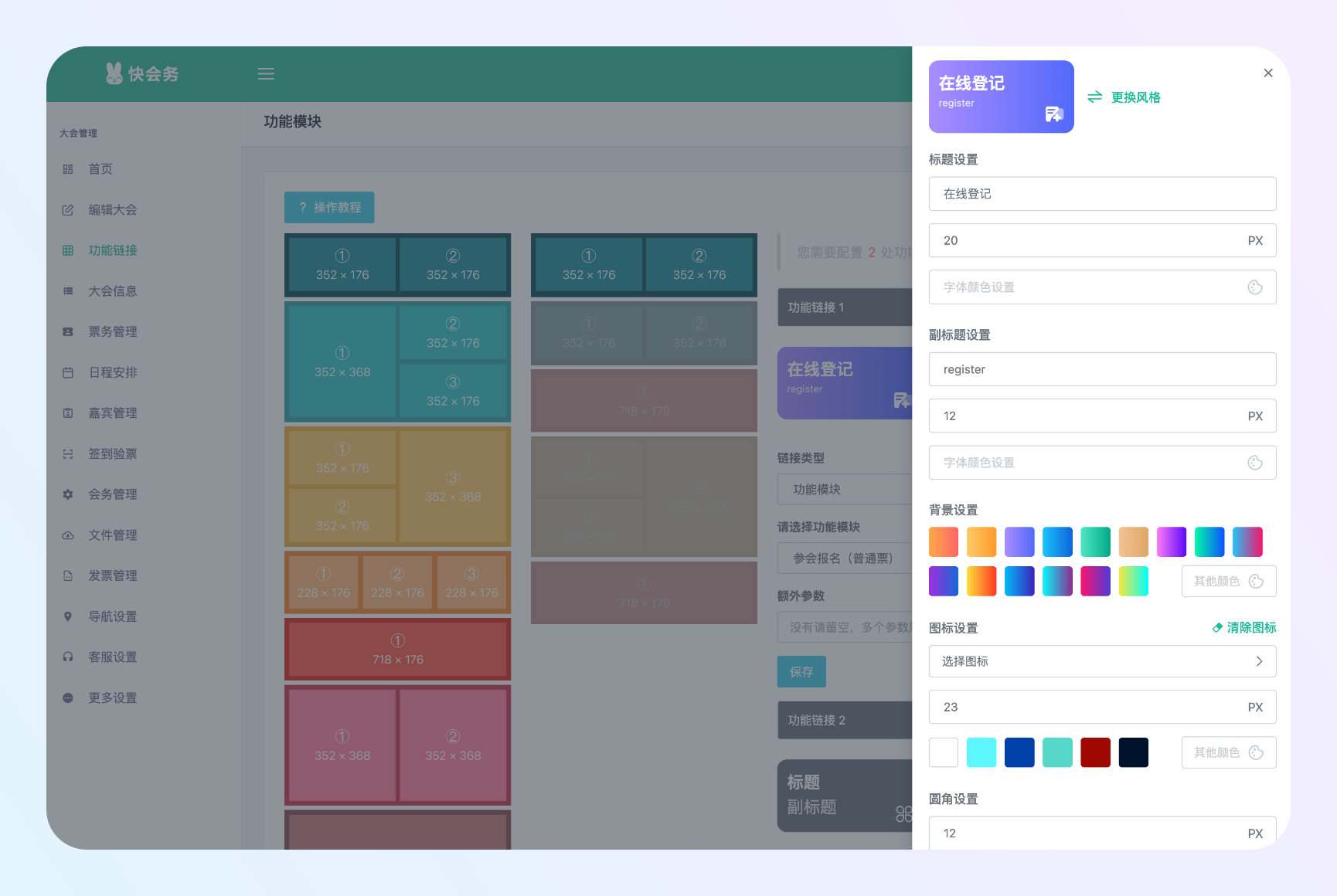

在数字化会务场景中,参会者通过签到小程序扫描二维码完成注册的流畅体验,背后是复杂的后台管理系统在默默支撑。这套被称作“隐形战线”的技术架构,需要同时处理在线注册、报名数据校验、电子签到实时核验、多终端数据同步等高并发任务。本文将以技术架构为切入点,结合快会务服务过的实际案例,解析后台管理系统如何通过分布式计算、智能调度和弹性扩展能力,为前台提供零故障的技术保障。

一、分布式服务器集群:百万级并发的基石

当一场国际医药峰会同时开启5个分会场的在线注册通道时,系统需要在30分钟内处理超过20万条报名数据。传统单体架构在此场景下必然崩溃,而分布式服务器集群通过将任务拆解至多个节点,实现了计算资源的横向扩展。快会务采用的Kubernetes容器编排技术,可动态创建数百个微服务实例,每个实例独立处理签到二维码生成、数据加密、API接口调用等子任务。

以2023年全球科技大会为例,其签到系统在开幕首日遭遇峰值并发量达127万次/小时的冲击。通过分布式架构的自动扩容机制,系统在8分钟内将计算节点从50台增加至320台,确保每个参会者的签到请求平均响应时间控制在200毫秒以内。这种弹性能力源于快会务自主研发的智能调度引擎,该引擎可实时监测各节点的CPU使用率、内存占用、网络延迟等12项指标,当任一指标超过阈值时自动触发扩容流程。

二、智能负载均衡:动态资源分配的艺术

在多终端签到场景中,系统需要同时支持小程序、H5页面、APP三种客户端的请求。智能负载均衡器通过分析请求来源、设备类型、网络环境等参数,将任务分配至最合适的服务器节点。例如,当检测到某区域网络延迟较高时,系统会自动将该区域的签到请求路由至就近的数据中心处理。

快会务为某跨国企业年会设计的混合云架构中,私有云承载核心数据库和敏感操作,公有云处理非关键业务请求。负载均衡器根据业务优先级动态调整资源分配比例,在保证数据安全的同时最大化利用计算资源。测试数据显示,该架构使系统整体吞吐量提升3.2倍,而资源成本仅增加18%。

三、数据库读写分离:数据安全的双重保障

会务管理系统每天产生海量结构化数据,包括参会者信息、签到记录、会议反馈等。读写分离架构通过将写操作(如注册信息更新)定向至主库,读操作(如签到状态查询)分散至多个从库,有效避免了单点故障风险。快会务采用的MySQL Group Replication技术,可实现主从库间的毫秒级数据同步,确保任何节点故障时都能快速切换至备用库。

在某医疗行业峰会的实践中,系统需要在4小时内完成1.2万名参会者的电子签到数据写入。通过读写分离架构,主库专注处理写入请求,8个从库同时承担查询任务,使整体处理效率提升5倍。更关键的是,当主库因突发流量出现15秒的短暂卡顿时,从库自动承接写操作,全程未影响前台签到流程。

四、实时监控大屏:故障预警的神经中枢

运维团队通过部署在控制中心的实时监控大屏,可同步观测全球200+个会场的系统运行状态。该大屏集成Prometheus监控系统与Grafana可视化工具,以热力图形式展示各节点的负载情况、错误率、响应时间等关键指标。当某指标连续3分钟超过预设阈值时,系统会自动触发三级预警机制:一级预警推送至现场运维人员,二级预警通知区域技术负责人,三级预警启动自动熔断机制。

快会务为某金融机构设计的监控体系中,包含132个自定义检测规则,可精准识别数据库连接泄漏、内存溢出、API超时等潜在风险。在2022年某场万人峰会中,系统提前47分钟预警到某签到设备的网络波动,运维团队通过远程重启设备避免了现场拥堵。据统计,该监控体系使故障发现时间从平均23分钟缩短至4.2分钟,故障修复效率提升81%。

五、弹性扩展能力:1小时完成资源扩容的实战

面对不可预测的流量洪峰,系统的弹性扩展能力成为关键。快会务采用的Serverless架构支持按秒计费的资源调用,当监测到持续10分钟的流量增长时,系统会自动启动扩容流程:首先在公有云创建新的计算实例,接着完成应用部署与配置同步,最后通过负载均衡器将流量逐步引导至新节点。整个过程无需人工干预,可在1小时内完成从百级到万级的资源扩容。

在某新能源汽车发布会的实战中,原预计5000人的参会规模因社交媒体传播激增至1.8万人。系统在签到开始前2小时自动触发扩容,新增的45台服务器使签到通道从8个增加至32个,最终实现98.7%的参会者在5分钟内完成签到。这种“未雨绸缪”的扩展策略,源于快会务独创的流量预测模型,该模型通过分析历史数据、社交媒体热度、天气因素等23个维度,可提前72小时预测参会人数波动范围。

六、快会务实战案例:从技术到体验的完整闭环

1. 国际医药峰会:面对来自127个国家的2.3万名参会者,系统通过多语言支持、时区自动转换、签证信息核验等功能,实现注册转化率提升40%。后台架构采用全球节点部署,确保欧美、亚太、中东地区用户的平均访问延迟低于300毫秒。

2. 全球科技大会:签到系统需同时支持NFC近场通信、人脸识别、二维码扫描三种方式。通过微服务架构,三种签到方式的数据处理流程完全解耦,任一模块故障不影响其他功能运行。最终实现99.98%的签到成功率,创下行业新纪录。(更多案例可前往“快会务·案例精选栏目”搜索查阅)

这些实战数据证明,优秀的后台管理系统不仅是技术堆砌,更需要将业务需求转化为技术指标的能力。快会务通过12年的行业深耕,已形成覆盖会前、会中、会后的全流程解决方案,其技术架构的可靠性在超过5000场大型会议中得到验证。